如果说有一项技术彻底改变了 21 世纪,那一定是人工智能。Google 新掌门人 Sundar Pichai 曾说:“人工智能带给我们生活和工作的改变,甚至将超过火和电。”虽然噱头满满,但不可否认的是,人工智能正在翻天覆地的改变着人们的生活方式。以前只有在科幻小说中才能了解到的工具和生活方式正在人工智能的加持下,从各个角度渗透进我们的日常生活,并带动着技术进步、产业升级、推动市场经济整体快速发展。因此,正确理解人工智能的概念就变得非常重要。本文将帮助你理解人工智能的定义、阶段、类型以及研究领域。

人工智能的定义

1956 年,John McCarthy(1927~2011)在达特茅斯会议上提出了“人工智能 (artificial intelligence,AI)”一词。他将人工智能定义为:

“制造智能机器的科学与工程。”

‘The science and engineering of making intelligent machines.’

人工智能也可定义为能够执行需要人类智能的任务的计算机系统的开发,如制定决策、检测对象、解决复杂问题等等。

人工智能的阶段

很多文章都认为,强人工智能(Artificial General Intelligence)、弱人工智能(Artificial Narrow Intelligence)以及超人工智能(Artificial Super Intelligence)是不同类型的人工智能。其实更确切地说,它们是人工智能的三个阶段。

弱人工智能(ANI)

弱人工智能,又称为狭义人工智能。在这一阶段,机器并不具备任何思维能力,只是执行一组预定义的功能,如语音识别、图像识别等,是擅长单个方面的人工智能,类似高级仿生学。它们只为解决某一特定具体的任务而存在,大多是统计数据,从中归纳出模型。比如, AlphaGo 只会下围棋,并不能执行其他任务。

弱人工智能的例子包括 Siri、Alexa、自动驾驶汽车、AlphaGo、人形机器人 Sophia 等。到目前为止,几乎所有基于人工智能的系统都属于弱人工智能。

强人工智能(AGI)

强人工智能,又称为通用人工智能。不同于弱人工智能,强人工智能可以像人类一样应对不同层面的问题,而不仅仅只是执行一组预定义的功能。不仅如此,强人工智能还具有自我学习、理解复杂理念等多种能力。也正如此,强人工智能的开发比弱人工智能要困难得多。事实上,人工智能国际主流学界所持的目标也仅局限于弱人工智能。目前很少有人进行强人工智能的研究,也尚未形成相应的成果。

强人工智能还被许多科学家视为对人类生存的威胁, Stephen Hawking 警告称:

“完全人工智能(Full Artificial Intelligence)的发展可能意味着人类文明的终结……人工智能一旦脱离束缚,会不断加速重新设计自身。而人类由于受到生物进化的时间限制,无法与之竞争,很可能会被取代。”

超人工智能(ASI)

当弱人工智能已经大部分实现,强人工智能正在通过深度学习不断逼近之时,超人工智能的概念呼之欲出。在这一阶段,计算机的能力将超越人类。目前,强人工能智能是电影和科幻小说中描述的一种假想情景:机器已经接管世界。

“人工智能(我指的不是狭义的人工智能)的发展速度快得令人难以置信。除非你能够直接接触到 DeepMind 这样的组织,否则你根本不会知道人工智能的增长速度有多快——它正以接近指数级的速度增长。在五年内(最多十年)将存在发生危险事件的风险。"

——Elon Musk

人工智能的类型

当有人让你解释不同类型的人工智能系统时,你必须根据它们的功能进行分类。密歇根州立大学 Arend Hintze 将人工智能分为以下几种类型:单一反应型、有限记忆型、具有心智型以及自我意识型。

单一反应型(Reactive Machine AI)

这种类型的人工智能是最基本的人工智能系统,它仅基于当前数据运行的机器,只考虑当前情况。也就是说,反应型机器只能进行反应,它既没有记忆能力,也无法利用过去的经验来制定现在的决策。

反应型机器的一个典型例子就是著名的 IBM 国际象棋程序 Deep Blue 。1997 年 5 月,它以 3.5:2.5 的战绩击败了世界冠军 Garry Kasparov,成为首个在标准比赛时限内击败国际象棋世界冠军的计算机系统。

Deep Blue 看似拥有人的智慧,实际上,它只关注棋盘上的现状,并在可能的走法中作出决策。除了遵守重复棋局不能连续出现三次的规定外,和经验丰富的人类不同,它对过去并没有任何概念。

目前的人工智能,要么对世界没有概念,要么只对其执行的特定任务有极其有限、具体的概念。Deep Blue 的创新之处在于,它放弃了拓宽计算机可能考虑的棋路范围的这种思路。相反,开发人员找到了一种方法,让它缩小自己的“视角”,根据它对某些走法的结果进行评估,停止追求一些可能的走法。类似地,AlphaGo 也无法评估所有的走法,但它采用了比 Deep Blue 更为复杂的方法:使用神经网络来评估棋局的走势。

这种类型的人工智能无法在专业领域之外发挥作用,而且容易被愚弄。它们无法通过交互的方式成为世界的组成部分。很显然,它们只是最基本的人工智能系统,并不符合我们对人工智能系统的未来预期,即能够与人类展开真正的互动,甚至对周围的环境作出真实的反应。

有限记忆型(Limited Memory AI)

有限的记忆,顾名思义,指人工智能可以通过研究以往的数据作出明智的决策。这种类型的人工智能具有短暂或临时的记忆,可以用来存储过去的经验并评估未来的行为。

自动驾驶汽车就是这种类型的人工智能,它利用最近收集的数据作出即时决定。例如,使用传感器识别过马路的行人、陡峭的道路以及交通信号等,从而作出更好的驾驶决策,这有助于防止交通事故的发生。

然而,自动驾驶汽车的历史信息存在的时间很短暂,无法像经验丰富的人类驾驶员那样将其存储在“经验库”中。这种类型的人工智能,并不能构建全面的“表现”(representations),它并不能记住自己的经验,并学会如何应对新的情况。

具有心智型(Theory Of Mind AI)

心智理论,心理学术语,是人类能够理解自身及周围人的心理状态的能力。这一理论来源于哲学,进入心理学领域后,慢慢成为认知心理学与神经心理学的研究重心之一。心智理论是人类社会形成的关键,通过这一理论,人们可以更好地理解社交、互动的内在动力。试想,如果人类不能理解彼此的动机和意图,那么,相互间的沟通、合作就会变得异常困难,甚至毫无可能。

这种类型的人工智能较前两种更为先进,它在心理学中扮演着重要的角色,主要体现在对机器“情商”的开发上。

如果人工智能系统真的能够与人类并肩行走,它们就必须能够明白,每个人都有思想和感受,理解人类预期,并由此调整自身行为,这正是我们目前的人工智能与未来的人工智能之间的重要差异。

自我意识型(Self-aware AI)

这是人工智能发展的最后一步:构建一套能够形成自我表征的系统。像 Elon Musk 和 Stephen Hawkings 这样的天才一直警告我们警惕人工智能的进化。让我们祈祷,我们永远不会达到这种人工智能的状态。因为,在这种状态下,机器将拥有自己的意识,它能够意识到自我,知道自己的内部状态,还可以预测他人的感受。当前,具有自我意识的人工智能离我们还有很远的距离。然而在未来,到达超人工智能的阶段仍存在可能。

人工智能的研究领域

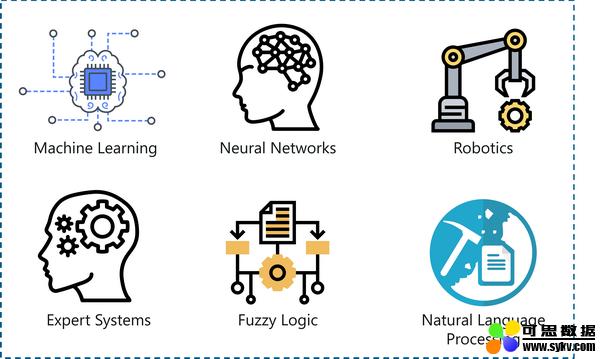

人工智能可以通过以下技术解决现实问题:

机器学习

深度学习

自然语言处理

机器人

模糊逻辑

专家系统

机器学习

机器学习是一门借助机器解释、处理和分析数据以解决实际问题的科学。它的根源可以追溯到 1952 年就职于 IBM 的 Arthur Samuel(被誉为“机器学习之父”)设计的一款西洋跳棋程序。机器学习有三种类型,分别为监督式学习、无监督式学习和强化学习。

毫无疑问,机器学习有助于人类克服知识和常识方面的瓶颈,而我们认为这些瓶颈会阻碍人类水平的人工智能的发展,因此许多人将机器学习视为人工智能的梦想。

想了解有关机器学习的更多信息,你可以浏览以下博客:

Machine Learning Tutorial for Beginners

What is Machine Learning? Machine Learning For Beginners

深度学习

深度学习是在高维数据上实现神经网络以获得洞察力并形成解决方案的过程。深度学习是机器学习的一个高级领域,可以用于解决更高级的问题,它是 Facebook、自动驾驶汽车、Siri、ALexa 等虚拟助手人脸认证算法背后的逻辑。

想了解有关深度学习的更多信息,你可以浏览以下博客:

What is Deep Learning? Getting Started With Deep Learning

Deep Learning Tutorial: Artificial Intelligence Using Deep Learning

自然语言处理

自然语言处理是一门从人类自然语言中提取洞察力,以便与机器交流并发展业务的科学。它也是人工智能中最古老、研究最多、要求最高的领域之一。开发智能系统的任何尝试,最终似乎都要解决一个问题,即使用何种形式的标准进行交流。例如,比起使用图形系统或基于数据系统的交流,语言交流通常是首选。

20 世纪四五十年代,人们使用有限自动机、形式语法和概率建立了自然语言理解的基础。但是,20 世纪五六十年代,早期使用机器翻译语言的尝试被实践证明是徒劳无功的。20 世纪 70 年代,当时的潮流趋于使用符号方法和随机方法。进入 21 世纪后,随着机器学习的兴起,自然语言处理迎来新的突破,并推动了随机过程、机器学习、信息提取和问答等现有方法的应用。比如,Twitter 使用自然语言处理技术来过滤推文中的恐怖主义的语言,Amazon 使用自然语言处理了解客户评论并改善用户体验。

机器人

人工智能机器人是在现实环境中行动的人工智能体,通过采取负责任的行动来产生结果。这一领域在计